别着急,坐和放宽

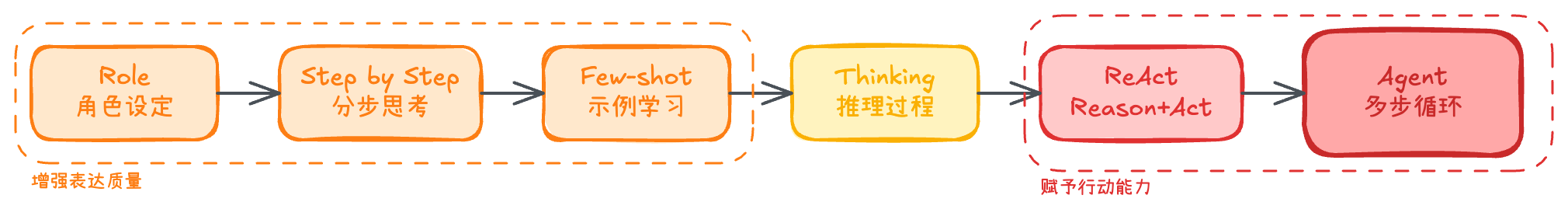

Agent 并不是突然出现的,它更像是 Prompt Engineering 一路“堆能力”的自然结果。在 Agent 之前,我们主要靠提示词让 LLM 更稳定地完成复杂任务,演进大致经历以下阶段:

0)Role:最早期的“角色设定”

最经典、最早期的提示方式是 Role Prompt:

“你是一个资深产品经理 / 你是一个资深 SRE / 你是一个代码审查专家……”

它的作用是给模型一个行为边界与输出风格,让回答更贴合领域语境,例如:

- 语气更专业

- 输出结构更像行业习惯

- 更倾向于该角色的关注点(风险、边界、指标等)

局限: Role 只能改变“说话方式和偏好”,并不会真正提高事实可靠性或执行能力。

1)Step by Step:让模型显式分步

随后常用的是:

“请一步一步思考 / Step by step”

它能显著提升复杂任务的完成率:模型会先拆解再回答,减少跳步错误。

2)Few-shot:用示例教会模型“套路”

Few-shot Prompt 是提供几个示例(输入→输出),让模型学习:

- 输出格式(如 JSON / 表格)

- 解决套路(如对比、分类、总结)

- 任务边界(什么该输出,什么不要输出)

3)Thinking:从“答案”到“推理过程”

再进一步,我们希望模型不仅给结论,还能给 reasoning / thinking:

- 让复杂任务更稳定

- 更利于 debug(知道它为什么这么做)

4)ReAct:把“思考(Reason)”和“行动(Act)”结合起来

ReAct(Reason + Act)是从 Prompt 到 Agent 的关键跃迁:

- Reason:决定下一步做什么

- Act:调用工具(搜索、数据库、API)并获取结果

这让 LLM 从“会推理”变成“会执行”。

5)Agent:多步循环 + 工具 + 状态

当 ReAct 再加上:

- 多轮循环(Plan-Act-Observe)

- 状态/记忆(Memory)

- 失败重试与校验

就形成了我们今天说的 Agent。

图:从 Prompt Engineering 到 Agent 的演进路径

CodeBlock Loading...

小结(可作为补充结尾)

从 Role 到 Step-by-step、Few-shot、Thinking,本质是在增强 LLM 的“表达质量与推理稳定性”;而从 ReAct 开始,模型被赋予了“行动能力”,再叠加循环与状态管理,就自然演进成 Agent 系统。